AI Bundesliga Prognose: Simulationen erklärt

Sportvorhersagen

Ladevorgang...

Ladevorgang...

Wenn von Supercomputern die Rede ist, die eine Bundesliga-Saison zehntausendmal durchspielen, klingt das nach Science-Fiction. Tatsächlich beschreibt es eine etablierte Methode der KI-Prognose: die Simulation. Statt eine einzelne Vorhersage zu treffen, werden Tausende möglicher Verläufe durchgerechnet. Das Ergebnis ist keine Behauptung, wer gewinnt, sondern eine Verteilung von Wahrscheinlichkeiten, die die Unsicherheit des Sports ehrlich abbildet. Verlasse dich auf unsere computergestützte AI Bundesliga Prognose.

Simulationsbasierte Prognosen haben in den letzten Jahren an Popularität gewonnen. Medien zitieren regelmäßig die Ergebnisse von Simulationen, sei es für Meisterschaftschancen, Abstiegsprognosen oder einzelne Spielausgänge. Der Opta Supercomputer ist dabei zum geflügelten Wort geworden. Doch was steckt hinter dieser Methodik, und wie verlässlich sind die Ergebnisse?

In diesem Artikel erklären wir die Grundlagen der Monte-Carlo-Simulation, schauen uns konkrete Anwendungen im Fußball an und diskutieren die Stärken und Grenzen dieses Ansatzes. Du erfährst, wie du Simulationsergebnisse richtig interpretierst und ob eigene Simulationen für Hobbyanalysten machbar sind.

Was ist eine Monte-Carlo-Simulation?

Das Grundprinzip verständlich erklärt

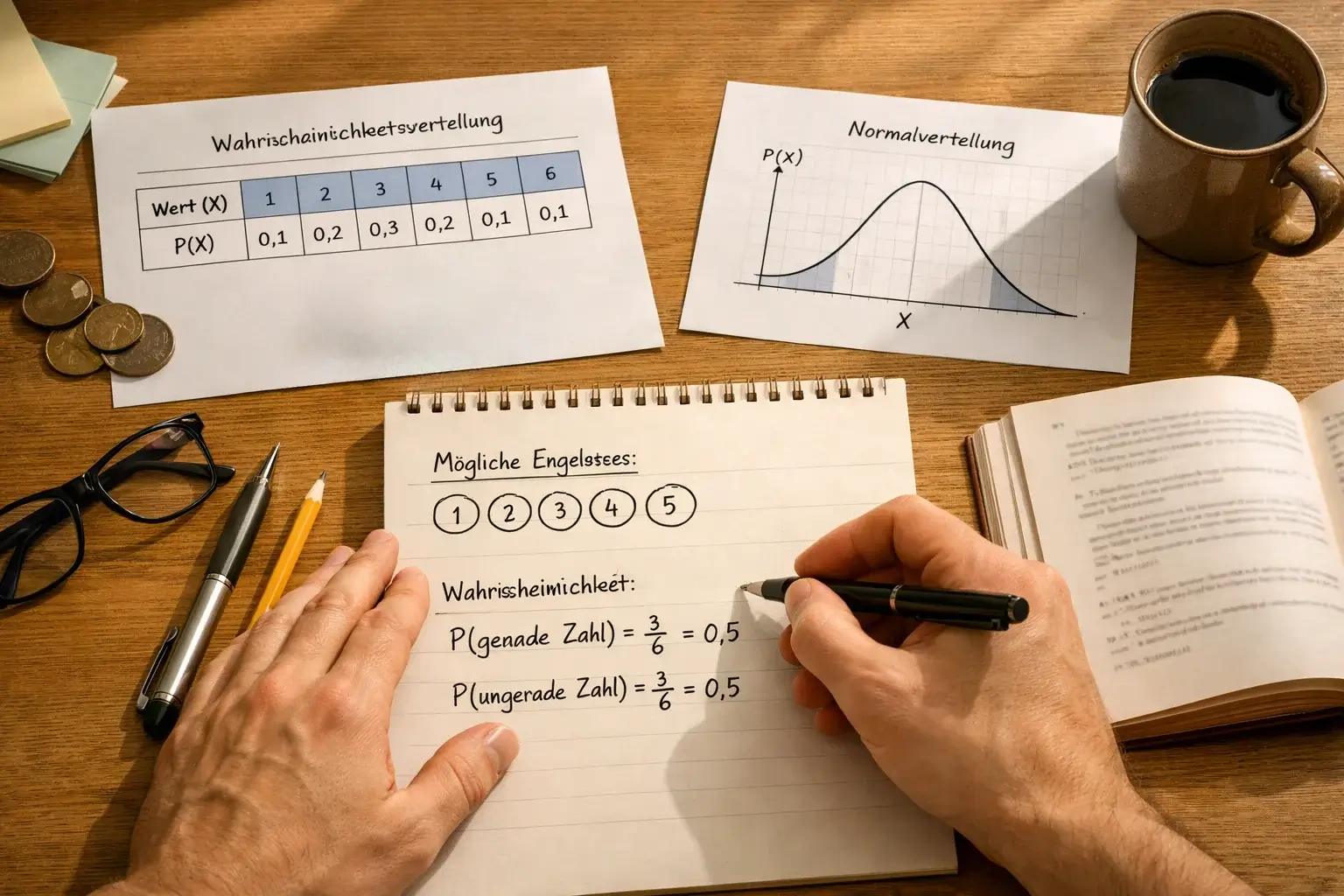

Die Monte-Carlo-Methode ist nach dem berühmten Kasino benannt, und das ist kein Zufall. Das Prinzip basiert auf wiederholtem Zufallsexperimentieren. Statt ein Problem analytisch zu lösen, simuliert man es viele Male mit zufälligen Inputs und schaut, welche Ergebnisse wie häufig auftreten.

Im Kontext einer Bundesliga-Prognose bedeutet das: Statt zu berechnen, wer wahrscheinlich Meister wird, simuliert man die komplette Saison. Jedes der 306 Spiele wird einzeln durchgespielt, wobei der Ausgang von den geschätzten Wahrscheinlichkeiten und einem Zufallselement abhängt. Am Ende steht eine simulierte Abschlusstabelle. Diesen Vorgang wiederholt man zehntausend- oder hunderttausendmal.

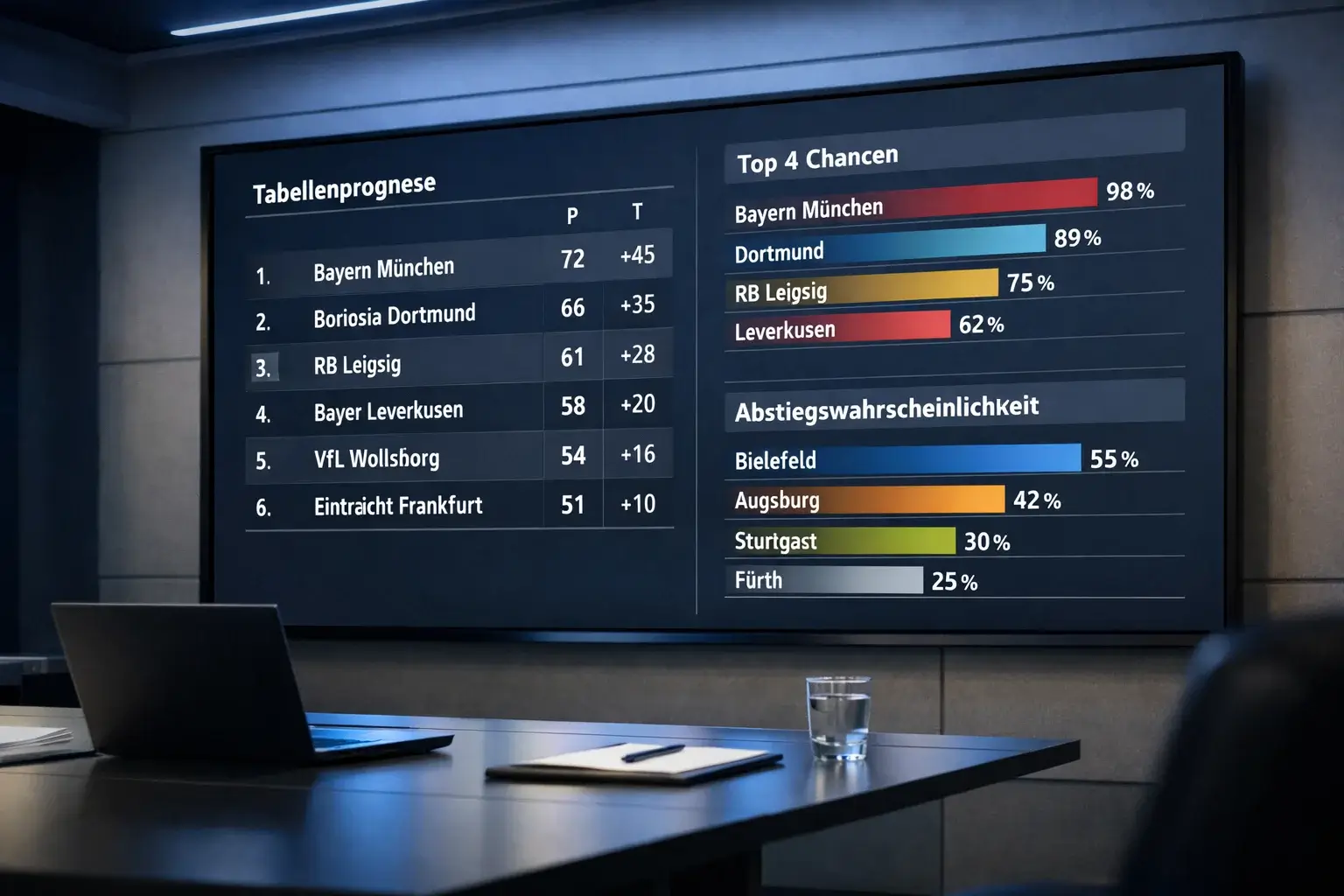

Das Ergebnis ist eine Sammlung von Abschlusstabellen. In manchen wurde Bayern München Meister, in manchen Borussia Dortmund, in einigen wenigen vielleicht sogar ein Außenseiter. Die Häufigkeit, mit der ein Team in den Simulationen Meister wird, entspricht seiner geschätzten Meisterschaftswahrscheinlichkeit. Wird Bayern in 65 Prozent der Simulationen Meister, ist das die Prognose.

Anwendung im Fußball

Die Monte-Carlo-Methode eignet sich hervorragend für Fußballprognosen, weil sie die komplexen Abhängigkeiten einer Saison abbilden kann. In einer Liga ist nicht jedes Spiel unabhängig: Die Ergebnisse der ersten Spieltage beeinflussen die Tabelle, die wiederum die Motivation und damit möglicherweise die Ergebnisse späterer Spiele beeinflusst.

Die Simulation kann solche Abhängigkeiten modellieren. Wenn in einer simulierten Saison ein Abstiegskandidat nach zwanzig Spieltagen überraschend auf Platz zehn steht, kann das seine Leistung für die restlichen Spiele beeinflussen. Diese dynamischen Effekte lassen sich in einer einfachen analytischen Berechnung nicht erfassen.

Ein weiterer Vorteil ist die Flexibilität. Die Simulation kann leicht angepasst werden, um Was-wäre-wenn-Szenarien durchzuspielen. Was passiert, wenn der Toptorjäger eines Teams für sechs Wochen ausfällt? Man simuliert die Saison mit entsprechend reduzierten Torerwartungen und sieht, wie sich die Wahrscheinlichkeiten verschieben.

Eine Beispielrechnung nachvollziehen

Um das Prinzip konkret zu machen, betrachten wir eine vereinfachte Simulation eines einzelnen Spiels. Team A hat eine geschätzte Siegwahrscheinlichkeit von 50 Prozent, Unentschieden 25 Prozent, Niederlage 25 Prozent. Die Simulation zieht eine Zufallszahl zwischen 0 und 100. Fällt sie zwischen 0 und 50, gewinnt Team A. Zwischen 50 und 75 endet das Spiel unentschieden. Zwischen 75 und 100 gewinnt Team B.

Für eine vollständige Spielsimulation braucht man auch die Torzahlen. Hier kommt oft die Poisson-Verteilung ins Spiel. Wenn Team A im Schnitt 1,8 Tore pro Spiel erzielt, zieht man eine Zufallszahl aus der Poisson-Verteilung mit diesem Mittelwert. Das Ergebnis könnte 0, 1, 2, 3 oder mehr Tore sein, mit den entsprechenden Wahrscheinlichkeiten.

Die Kombination aller simulierten Spielergebnisse einer Saison ergibt eine Abschlusstabelle. Wiederholt man diesen Vorgang zehntausendmal, erhält man zehntausend Tabellen. Die Auswertung zeigt dann: In wie vielen Simulationen wurde Team A Meister? In wie vielen stieg Team B ab? Diese Häufigkeiten sind die Prognosewahrscheinlichkeiten.

Der Opta Supercomputer

Zehntausend Simulationen pro Saison

Der Opta Supercomputer ist das bekannteste Beispiel für simulationsbasierte Fußballprognosen. Betrieben von Stats Perform, simuliert er regelmäßig die verbleibende Saison und veröffentlicht Wahrscheinlichkeiten für Meisterschaft, Abstieg und Europacup-Plätze. Die Ergebnisse werden von großen Medien zitiert und haben erhebliche Reichweite.

Die Bezeichnung Supercomputer ist dabei etwas irreführend. Die Berechnungen erfordern keine außergewöhnliche Rechenleistung. Zehntausend Saisonsimulationen sind auf einem modernen Laptop in Sekunden erledigt. Der Begriff dient eher dem Marketing als der technischen Beschreibung. Die Stärke liegt nicht in der Hardware, sondern in der Qualität der zugrundeliegenden Wahrscheinlichkeitsschätzungen.

Die Simulationen werden nach jedem Spieltag aktualisiert. Die neuen Ergebnisse fließen in die Wahrscheinlichkeitsmodelle ein, und die verbleibende Saison wird neu simuliert. Im Laufe der Saison werden die Prognosen präziser, weil weniger Spiele simuliert werden müssen und mehr Information über die tatsächliche Spielstärke vorliegt.

Die Methodik hinter den Zahlen

Die Qualität einer Simulation hängt von den Inputwahrscheinlichkeiten ab. Der Opta Supercomputer nutzt die umfangreichen Daten von Stats Perform, einem der größten Sportdatenanbieter weltweit. Dutzende von Metriken fließen in die Schätzung der Spielwahrscheinlichkeiten ein: xG, Formkurve, Heimvorteil, Head-to-Head-Bilanz und viele mehr.

Die genaue Gewichtung dieser Faktoren ist proprietär und nicht öffentlich dokumentiert. Das macht die Einschätzung der Methodik schwierig. Kritiker bemängeln die fehlende Transparenz, Befürworter verweisen auf die historische Genauigkeit der Prognosen.

Ein wichtiger Aspekt ist die Berücksichtigung von Unsicherheit. Nicht nur das erwartete Ergebnis wird modelliert, sondern auch die Varianz. Ein Spiel zwischen zwei gleichstarken Teams hat andere Schwankungsbreite als eines zwischen Favorit und Außenseiter. Diese Nuancen beeinflussen die Simulationsergebnisse.

Bisherige Erfolge und Grenzen

Die historische Bilanz des Opta Supercomputers ist gemischt. Bei den Meisterschaftsprognosen liegt die Trefferquote bei etwa 70 Prozent, was besser ist als einfache Heuristiken, aber keine Wunder vollbringt. Bei den Abstiegsprognosen ist die Genauigkeit ähnlich. Die Simulation identifiziert die wahrscheinlichsten Outcomes, aber Überraschungen passieren regelmäßig.

Ein berühmtes Beispiel für die Grenzen war Leicester Citys Meisterschaft in der Premier League 2016. Zu Saisonbeginn gaben die Simulationen Leicester eine Chance von unter einem Prozent. Selbst als das Team an der Spitze stand, blieben die Wahrscheinlichkeiten lange skeptisch. Die Simulation konnte den historischen Ausreißer nicht antizipieren.

Diese Grenzen sind kein Versagen der Methodik, sondern reflektieren die inhärente Unsicherheit des Sports. Auch die beste Simulation kann nicht vorhersagen, wann ein Team über sich hinauswächst oder unerwartet einbricht. Was sie kann, ist eine ehrliche Einschätzung der Wahrscheinlichkeiten liefern, die dann manchmal von der Realität widerlegt wird.

Andere Simulationsansätze

Agent-basierte Modelle

Neben der klassischen Monte-Carlo-Simulation existieren alternative Ansätze. Agent-basierte Modelle simulieren nicht nur Ergebnisse, sondern das Spielgeschehen selbst. Jeder Spieler wird als Agent modelliert, der auf Basis bestimmter Regeln agiert. Das Zusammenspiel der Agenten erzeugt das Spielergebnis.

Der Vorteil dieses Ansatzes liegt in der Detailtiefe. Die Simulation kann taktische Formationen abbilden, individuelle Spielerstärken berücksichtigen und die Dynamik eines Spiels nachvollziehen. Ein Rückstand verändert das Verhalten der Agenten, ein Platzverweis reduziert die Optionen. Diese Komplexität geht über einfache Ergebnissimulationen hinaus.

Der Nachteil ist der enorme Aufwand. Agent-basierte Modelle erfordern detaillierte Daten zu jedem Spieler und aufwendige Kalibrierung. Die Rechenzeit steigt dramatisch, weil nicht nur Ergebnisse, sondern ganze Spielverläufe simuliert werden. Für Prognosen einzelner Spiele kann der Ansatz sinnvoll sein, für Saisonprognosen ist er meist zu aufwendig.

Event-Simulation für detaillierte Analyse

Event-Simulationen modellieren nicht das gesamte Spiel, sondern einzelne Ereignisse wie Torschüsse, Fouls oder Ecken. Die Häufigkeit und Art dieser Ereignisse wird aus historischen Daten geschätzt, und die Simulation generiert einen Ereignisstrom, der in ein Ergebnis mündet.

Dieser Ansatz ist besonders nützlich für Wettmärkte jenseits des einfachen 1X2. Die Anzahl der Ecken, die Zahl der Karten oder das genaue Torergebnis lassen sich mit Event-Simulationen besser prognostizieren als mit einfachen Wahrscheinlichkeitsschätzungen.

Die Herausforderung liegt in der Modellierung der Abhängigkeiten zwischen Events. Ein frühes Tor verändert die Wahrscheinlichkeiten für spätere Ereignisse: Das führende Team zieht sich zurück, der Rückständige riskiert mehr. Diese Dynamik muss die Simulation erfassen, um realistische Ergebnisse zu liefern.

Hybride Ansätze kombinieren Stärken

In der Praxis nutzen viele fortschrittliche Prognosesysteme hybride Ansätze. Die grundlegenden Spielwahrscheinlichkeiten werden mit statistischen Modellen geschätzt, und diese werden dann in einer Monte-Carlo-Simulation für die Saison verwendet. Innerhalb einzelner Spiele können Event-Simulationen zum Einsatz kommen.

Die Kombination ermöglicht die Nutzung der jeweiligen Stärken. Statistische Modelle sind schnell und robust für die Grundschätzung. Simulationen erfassen die Dynamik und Unsicherheit einer Saison. Event-Modelle liefern Details für spezielle Wettmärkte.

Die Weiterentwicklung geht in Richtung zunehmender Integration. Machine-Learning-Modelle lernen optimale Kombinationen verschiedener Ansätze. Die Grenzen zwischen den Methoden verschwimmen, und das Ergebnis sind immer präzisere Prognosen.

Vor- und Nachteile von Simulationen

Stärken bei komplexen Szenarien

Simulationen entfalten ihre Stärke bei Fragestellungen, die analytisch schwer zu lösen sind. Die Wahrscheinlichkeit, dass ein Team Meister wird, hängt von den Ergebnissen aller anderen Teams ab. Diese Abhängigkeiten explizit zu berechnen ist mathematisch komplex. Die Simulation umgeht das Problem, indem sie einfach durchspielt, was passieren könnte.

Szenario-Analysen sind ein weiteres Einsatzgebiet. Was passiert mit den Meisterschaftschancen, wenn Team A das direkte Duell gegen Team B verliert? Die Simulation kann dieses Szenario durchspielen und zeigen, wie sich die Wahrscheinlichkeiten verschieben. Solche Was-wäre-wenn-Fragen sind für strategische Überlegungen wertvoll.

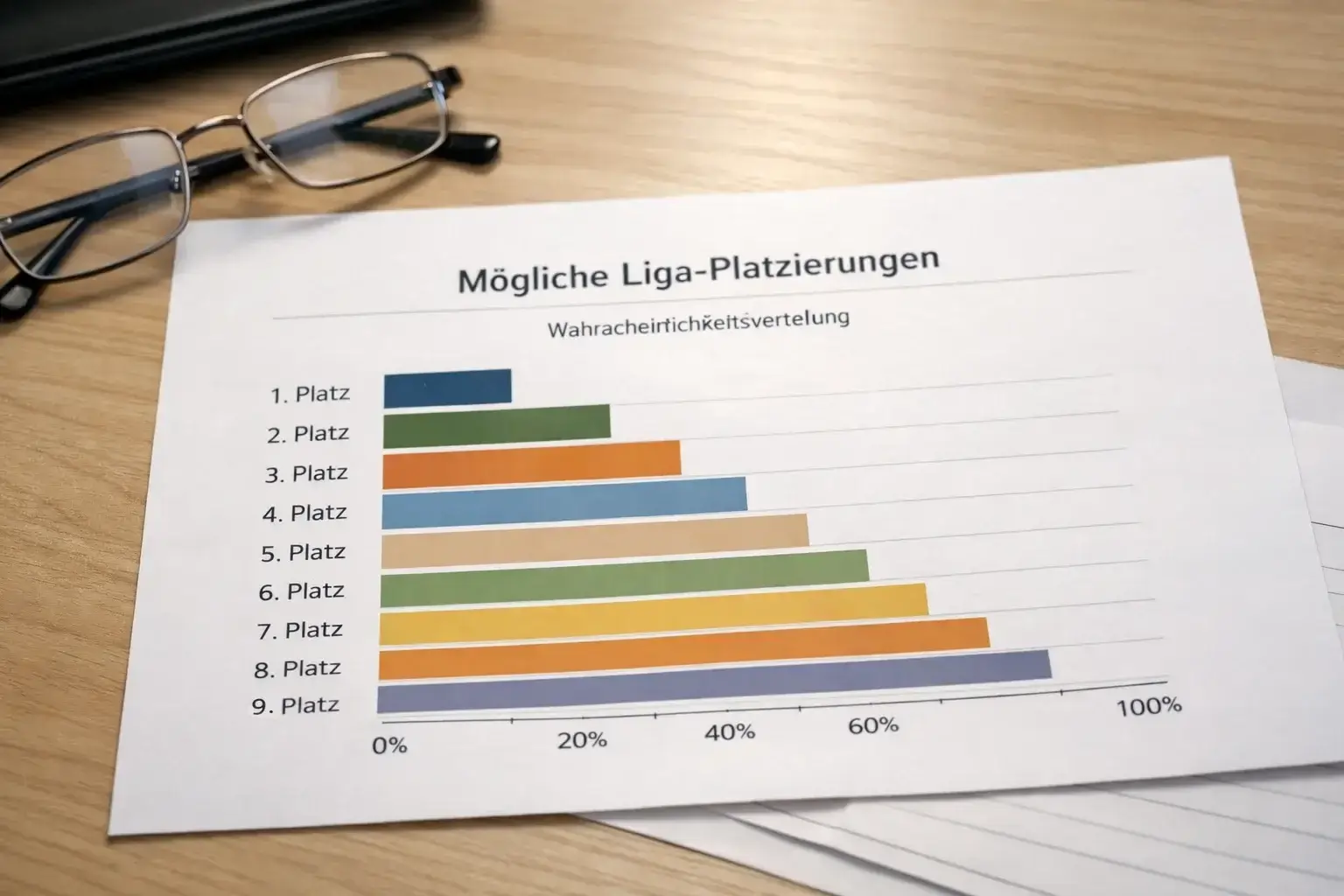

Die ehrliche Kommunikation von Unsicherheit ist eine weitere Stärke. Eine Simulation behauptet nicht, zu wissen, wer Meister wird. Sie zeigt eine Verteilung von Möglichkeiten, die der tatsächlichen Unsicherheit des Sports entspricht. Diese Ehrlichkeit ist wissenschaftlich korrekt und praktisch nützlich.

Rechenaufwand und Ressourcen

Der Rechenaufwand von Simulationen ist höher als bei einfachen analytischen Berechnungen, aber mit moderner Hardware gut handhabbar. Eine Saisonsimulation mit zehntausend Durchläufen dauert Sekunden. Selbst hunderttausend Durchläufe sind in Minuten erledigt. Die Bezeichnung Supercomputer ist daher übertrieben.

Der eigentliche Aufwand liegt nicht in der Simulation selbst, sondern in der Erstellung der Inputmodelle. Die Wahrscheinlichkeitsschätzungen für jedes Spiel erfordern Datensammlung, Feature-Engineering und Modelltraining. Dieser vorgelagerte Aufwand ist erheblich und bestimmt die Qualität der Simulation.

Für Hobbyanalysten ist der Einstieg dennoch machbar. Einfache Simulationen mit öffentlich verfügbaren Daten sind ohne großen Aufwand realisierbar. Die Qualität wird nicht an professionelle Systeme heranreichen, aber für Lernzwecke und grundlegende Analysen genügt sie.

Grenzen der Simulationsmethodik

Die fundamentale Grenze jeder Simulation ist die Qualität der Inputs. Die Simulation kann nur so gut sein wie die Wahrscheinlichkeitsschätzungen, auf denen sie basiert. Garbage in, garbage out gilt auch hier. Eine Simulation mit schlechten Inputdaten liefert elegante, aber falsche Ergebnisse.

Ein weiteres Problem ist die Modellierung seltener Ereignisse. Überraschungsmeister wie Leicester oder Aufsteiger, die sofort wieder absteigen, werden von Simulationen systematisch unterschätzt. Die historischen Daten enthalten zu wenige solcher Ereignisse, um ihre Wahrscheinlichkeit korrekt zu schätzen.

Schließlich kann keine Simulation die Zukunft kennen. Verletzungen, Trainerwechsel, interne Konflikte und andere unvorhersehbare Faktoren beeinflussen den Saisonverlauf, aber sie lassen sich nicht simulieren. Die Prognose gilt unter der Annahme, dass keine dramatischen Veränderungen eintreten, was oft nicht zutrifft.

Simulationsergebnisse interpretieren

Wahrscheinlichkeitsverteilungen richtig lesen

Das Ergebnis einer Simulation ist keine einzelne Zahl, sondern eine Verteilung. Ein Team hat nicht eine Meisterschaftswahrscheinlichkeit von 45 Prozent, sondern eine Verteilung möglicher Endplatzierungen. Die 45 Prozent beschreiben nur, wie oft Platz eins erreicht wurde. Platz zwei oder drei wurden vielleicht in weiteren 30 Prozent der Simulationen erreicht.

Die vollständige Verteilung ist informativer als die Zusammenfassung. Ein Team mit 40 Prozent Meisterchance und 35 Prozent für Platz zwei bis vier ist anders einzuschätzen als eines mit 40 Prozent Meisterchance und 30 Prozent für Platz fünf bis acht. Das erste Team hat eine enge Verteilung und ist relativ sicher in der Spitzengruppe. Das zweite hat eine breitere Verteilung und könnte auch weiter unten landen.

Für Wettentscheidungen ist die vollständige Verteilung wertvoll. Eine Wette auf eine Top-4-Platzierung hat andere Erfolgschancen als eine reine Meisterwette. Die Simulation liefert beide Wahrscheinlichkeiten und ermöglicht den Vergleich mit den angebotenen Quoten.

Konfidenzintervalle verstehen

Auch Simulationsergebnisse haben Unsicherheit. Wenn man die Simulation erneut durchführt, werden die Ergebnisse leicht variieren. Diese Varianz wird durch die Anzahl der Simulationsdurchläufe bestimmt: Mehr Durchläufe bedeuten stabilere Ergebnisse.

Konfidenzintervalle quantifizieren diese Unsicherheit. Eine Meisterschaftswahrscheinlichkeit von 45 Prozent mit einem 95-Prozent-Konfidenzintervall von 43 bis 47 Prozent bedeutet, dass der wahre Wert mit hoher Sicherheit in diesem Bereich liegt. Bei einem Intervall von 35 bis 55 Prozent ist die Unsicherheit deutlich größer.

Für praktische Zwecke sind zehntausend Simulationen meist ausreichend, um enge Konfidenzintervalle zu erhalten. Die verbleibende Unsicherheit ist dann kleiner als die Unsicherheit in den Inputmodellen, sodass weitere Simulationen wenig bringen.

Praktische Anwendung für Wetten

Die Nutzung von Simulationsergebnissen für Wetten folgt dem üblichen Prinzip: Vergleiche die simulierte Wahrscheinlichkeit mit der Quote und identifiziere Value. Wenn die Simulation einem Team 30 Prozent Chance auf eine Top-4-Platzierung gibt und die Quote 4,50 beträgt, was etwa 22 Prozent impliziert, liegt potenziell Value vor.

Langzeitwetten profitieren besonders von Simulationen, weil sie die komplexen Abhängigkeiten einer Saison erfassen. Für einzelne Spiele sind Simulationen weniger nötig, weil die direkten Wahrscheinlichkeitsschätzungen ausreichen. Der Mehrwert der Simulation liegt in der Aggregation über viele Spiele.

Die Kombination aus Simulation und eigenem Urteil ist oft sinnvoll. Wenn du einen Faktor kennst, den die Simulation nicht berücksichtigt, kannst du die Wahrscheinlichkeiten manuell anpassen. Diese Kombination aus algorithmischer Analyse und menschlicher Einschätzung liefert oft die besten Ergebnisse.

Eigene Simulation durchführen

Tools für Hobbyanalysten

Wer selbst Simulationen durchführen möchte, findet verschiedene Einstiegsmöglichkeiten. Die einfachste ist eine Tabellenkalkulation wie Excel. Mit etwas Aufwand lässt sich eine Saisonsimulation aufbauen, die Zufallszahlen für die Spielergebnisse generiert und die Tabelle berechnet. Die Aktualisierung über mehrere Durchläufe erfordert Makros oder manuelle Arbeit.

Komfortabler sind Programmiersprachen wie Python oder R. Mit wenigen Zeilen Code lässt sich eine Monte-Carlo-Simulation implementieren, die zehntausend Saisonen in Sekunden durchrechnet. Bibliotheken für Statistik und Datenverarbeitung vereinfachen die Arbeit. Tutorials und Codebeispiele sind online reichlich verfügbar.

Für den schnellen Einstieg ohne Programmierung gibt es webbasierte Tools, die Simulationen ermöglichen. Die Funktionalität ist eingeschränkt, aber für erste Experimente ausreichend. Die eigentliche Arbeit liegt ohnehin in den Inputdaten, nicht in der Simulation selbst.

Ressourcen und Lernmaterial

Die Fußball-Analytics-Community ist aktiv und teilt Wissen großzügig. Blogs wie The Analyst, StatsBomb oder deutsche Pendants bieten Tutorials zur Simulation. Akademische Paper behandeln die Methodik theoretisch, sind aber oft schwer zugänglich.

Für den praktischen Einstieg empfehlen sich projektbasierte Tutorials. Baue eine einfache Simulation für die aktuelle Bundesliga-Saison und vergleiche deine Prognosen mit denen von Opta oder anderen Anbietern. Die Diskrepanzen zeigen, wo dein Modell verbesserungsfähig ist.

Die kontinuierliche Verbesserung ist der Schlüssel. Jede Saison liefert neue Daten, die zur Kalibrierung genutzt werden können. Der Vergleich von Prognose und Realität zeigt Schwächen auf. Mit der Zeit wird das eigene Modell immer besser, auch wenn es professionelle Systeme nie erreichen mag.

Die Zukunft simulationsbasierter Prognosen

Technologische Entwicklungen

Die Simulationsmethodik entwickelt sich kontinuierlich weiter. Neue Datenquellen wie Tracking-Daten, die Spielerpositionen in Echtzeit erfassen, ermöglichen detailliertere Modelle. Statt nur Ergebnisse zu simulieren, können zukünftige Systeme ganze Spielverläufe auf Basis von Positionsdaten generieren.

Künstliche Intelligenz verbessert die Inputmodelle. Machine-Learning-Algorithmen erkennen Muster in den Daten, die menschlichen Analysten verborgen bleiben. Diese Muster fließen in die Wahrscheinlichkeitsschätzungen ein und erhöhen die Prognosegenauigkeit.

Cloud-Computing macht massive Simulationen für jedermann zugänglich. Wer eine Million Saisonsimulationen durchführen möchte, kann Cloud-Ressourcen mieten und in Minuten fertig sein. Die Demokratisierung der Rechenleistung senkt die Einstiegshürden für ambitionierte Hobbyanalysten.

Integration verschiedener Datenquellen

Die Simulationen der Zukunft werden mehr Datenquellen integrieren als heutige Systeme. Neben den klassischen Spielstatistiken könnten Social-Media-Analysen die Stimmung in Vereinen erfassen. Wetterdaten, Anreiseinformationen und sogar psychologische Profile von Spielern könnten Eingang finden.

Diese Integration stellt neue Herausforderungen. Mehr Daten bedeuten nicht automatisch bessere Prognosen. Die Gefahr des Overfittings steigt, wenn zu viele Variablen einbezogen werden. Die Kunst liegt in der Auswahl der wirklich relevanten Informationen.

Die Interpretation wird komplexer. Wenn ein Simulationsergebnis auf dreißig verschiedenen Inputfaktoren basiert, ist es schwer nachzuvollziehen, warum ein bestimmtes Team favorisiert wird. Erklärbare KI wird wichtiger, um Vertrauen in die Prognosen zu schaffen.

Auswirkungen auf den Wettmarkt

Je präziser die Simulationen werden, desto mehr nähern sich die Wettquoten den wahren Wahrscheinlichkeiten an. Die Buchmacher nutzen selbst fortschrittliche Modelle und passen ihre Quoten entsprechend an. Der Vorteil für den informierten Wetter könnte schrumpfen.

Gleichzeitig entstehen neue Märkte, die von präziseren Simulationen profitieren. Exotische Wetten auf spezifische Spielereignisse, komplexe Kombiwetten oder Saisonwetten auf ungewöhnliche Outcomes werden möglich, wenn die Wahrscheinlichkeiten zuverlässig geschätzt werden können.

Die Spannung zwischen technologischem Fortschritt und Marktanpassung bleibt dynamisch. Wer einen Informationsvorsprung hat, kann davon profitieren, aber dieser Vorsprung ist temporär. Der nächste Durchbruch in der Prognosetechnologie verschiebt die Verhältnisse erneut.

Praktische Tipps für den Einsatz von Simulationen

Kombinieren statt Vertrauen

Simulationsergebnisse sollten nicht isoliert betrachtet werden. Sie sind ein Input unter mehreren für die eigene Entscheidungsfindung. Die Kombination mit anderen Informationsquellen, sei es Expertenanalysen, aktuelle Nachrichten oder eigene Beobachtungen, liefert ein vollständigeres Bild.

Wenn die Simulation einen Ausgang als wahrscheinlich einstuft, den dein Bauchgefühl ablehnt, lohnt die Analyse der Diskrepanz. Vielleicht kennst du einen Faktor, den die Simulation nicht berücksichtigt. Vielleicht hat die Simulation aber auch ein Muster erkannt, das deiner Intuition widerspricht. Die Wahrheit liegt oft dazwischen.

Die beste Strategie ist der disziplinierte Abgleich. Notiere deine eigene Einschätzung, bevor du die Simulation konsultierst. Vergleiche dann beide und analysiere Unterschiede. Mit der Zeit entwickelst du ein Gespür dafür, wann du der Simulation vertrauen solltest und wann deiner Intuition.

Realistische Erwartungen setzen

Simulationen verbessern die Prognosequalität, aber sie schaffen keine Gewissheit. Auch die besten Systeme liegen regelmäßig daneben, weil Fußball ein Sport mit hoher Varianz ist. Eine Erwartung von 100 Prozent Trefferquote ist unrealistisch und führt zu Enttäuschung.

Eine realistische Erwartung ist eine leichte Verbesserung gegenüber einfachen Heuristiken. Wenn du ohne Simulation bei 50 Prozent Trefferquote liegst und mit Simulation bei 55 Prozent, ist das ein erheblicher Vorteil über viele Wetten hinweg. Mehr sollte man nicht erwarten.

Die emotionale Vorbereitung auf Fehlschläge ist wichtig. Wenn eine Simulation einen Ausgang mit 70 Prozent Wahrscheinlichkeit vorhersagt und das Gegenteil eintritt, ist das kein Versagen der Methodik. Es ist das erwartete Ergebnis in 30 Prozent der Fälle. Langfristiges Denken hilft, solche Rückschläge einzuordnen.

Zusammenfassung und Ausblick

Simulationsbasierte Prognosen sind ein leistungsfähiges Werkzeug für Bundesliga-Analysen. Die Monte-Carlo-Methode ermöglicht die Erfassung komplexer Abhängigkeiten und die ehrliche Kommunikation von Unsicherheit. Der Opta Supercomputer und ähnliche Systeme nutzen diese Methodik für ihre regelmäßigen Prognosen.

Die Qualität einer Simulation hängt von den Inputwahrscheinlichkeiten ab. Die Simulation selbst ist nur eine Rechenoperation, die keine neuen Informationen erzeugt. Wer die Inputs verbessert, verbessert auch die Simulation. Die Grenzen liegen in der Vorhersagbarkeit des Sports selbst, nicht in der Methodik.

Für den praktischen Einsatz gilt: Simulationsergebnisse sind Wahrscheinlichkeiten, keine Gewissheiten. Sie sollten als informierte Schätzungen betrachtet werden, die mit eigenem Urteil und Kontextwissen kombiniert werden. Die Kombination aus algorithmischer Präzision und menschlicher Einschätzung liefert die besten Entscheidungsgrundlagen.

Die Zukunft verspricht weitere Verbesserungen durch neue Datenquellen und fortschrittlichere Algorithmen. Ein Vergleich lohnt sich: Schau dir unsere KI-basierten Experten-Tipps an. Wer sich heute mit den Grundlagen vertraut macht, ist für diese Entwicklungen gut vorbereitet. Die Simulation wird nicht das letzte Wort in der Fußballprognose sein, aber sie bleibt ein wichtiger Bestandteil des analytischen Werkzeugkastens.